eXtra vyvrací fake news: Jak se nenechat oblbnout umělou inteligencí

Fotky a videa vyrobená pomocí umělé inteligence se neustále zlepšují a tvoří čím dál větší část internetu. To může být problém. Pomocí AI se dá snadno vytvořit lež, a událost, která se vůbec nestala. AI tak dokáže člověku zničit reputaci nebo život, může ho zmanipulovat, nebo přesvědčit o lži. Můžeme tedy vůbec věřit všemu, co vidíme v online světě? A jak taková uměle vytvořená videa poznat? Na to se podívala redakce eXtra.cz.

Když si založíte nový účet na YouTube, je velká pravděpodobnost, že 20 % videí, která vám tato sociální síť doporučí, jsou produkty vytvořené pomocí AI, ukázala studie. Proto je dobré vědět, jak je vůbec možné AI video rozpoznat.

A tady máme špatné zprávy. Podle odborníků z MIT neexistuježádný jednoznačný a zaručený znak, podle kterého by se dalo stoprocentně poznat video nebo obrázek upravený pomocí AI. Je ale několik věcí, které nám aspoň napoví, že může jít o manipulaci.

Můžeme třeba sledovat, jestli v rohu videa není vodotisk AI platformy, kde bylo video vygenerované. Pokud je tam třeba logo platformy Sora, jde dost pravděpodobně o obsah vytvořený AI.

Jak rozpoznat AI

Zaměřit bychom se měli taky na délku videa. Většina videí tvořených pomocí umělé inteligence je totiž velmi krátká a mají jen pár sekund. Důvodem je to, že vytvoření AI videí je nákladné, takže většina nástrojů vyrábí jen krátké klipy. Čím delší video je, tím pravděpodobnější je, že AI udělá chybu.

Je zajímavé, že někdy může být poznávacím znamení AI videa i to, že se ho jeho tvůrce snažil zamaskovat tím, že snížil jeho kvalitu. Docela nedávno se na sociálních sítích objevilo video divokých králíků hopsajících na trampolíně. Podle BBC mělo tohle video přes 240 milionů zhlédnutí. Podobných videí kolovalo po internetu víc, na jednom z nich klokana polekala halloweenská dekorace.

A jak lidé poznali, že jde o AI? Klipy vypadaly jako záběry bezpečnostních kamer natočené v noci. Tím tvůrce zkoušel maskovat jejich původ, ale neúspěšně. Ale pozor, některé fotky a videa vytvořená AI zase vypadají až moc dobře a uměle na to, aby byla skutečná.

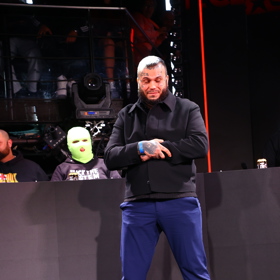

Doporučené video: eXtra versus deepfake

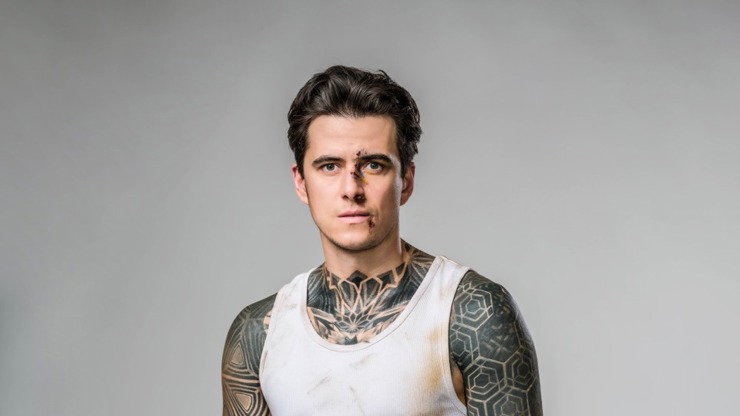

Pozor na obličeje

Věnujte pozornost i tomu, jak vypadáobličej člověka na fotce nebo videu. A všímejte si, co tam nesedí. Jak vypadají jeho tváře a čelo? Odpovídá podoba kůže tomu, jak je ten člověk starý? Jsou stíny okolo očí tam, kde by měly být? AI videa a podvrhy často neodpovídají fyzikálním zákonům, proto na nich nemusí sedět například odlesk na brýlích.

Měli bychom sledovat i další prvky na obličeji, třeba to, jestli vousy zobrazeného člověka vypadají skutečně nebo jestli osoba mrká dostatečně, nebo až moc na to, aby šlo o záznam skutečnosti. Je dobré sledovat, jestli člověk nemá divné výrazy obličeje nebo rozmazání u uší a vlasů a jestli se hýbe přirozeně.

Dalším vodítkem jsou pak rty. V některých AI videích totiž to, co člověk říká, neodpovídá tomu, jak se pohybují jeho rty.

Jak poznat videa generovaná pomocí AI vysvětluje také tvůrce Jeremy Carrasco. Podle něj totiž hlavní rozdíl mezi AI videem a skutečným videem spočívá také v kameře.

„Za kamerou nestojí skutečná osoba. Proto je pohyb kamery často nelogický. Je třeba se zastavit a zeptat se, kdo by to natočil a proč?“ zdůrazňuje a dodává, že se na internetu objevilo mnoho populárních videí, kde psi zachraňují děti před padajícími policemi a kamera je vždy až podezřele perfektně umístěná.

Negativní dopady

A proč někteří lidé vůbec vytvářejí na sítích profily, které chrlí AI videa? Někdy jde jen o výdělek. Takové profily totiž mohou vydělávat peníze na základě toho, kolik lidí si jejich video pustí nebo na něj zareaguje. Jenže AI videa mohou být používaná i k tomu, aby nás někdo zmanipuloval. Je proto dobré se ptát, jak a odkud se k nám takové video dostalo a kdo nám ho poslal? Kdo ho dal na internet?

Další negativní dopady AI videí vidíme kolem sebe už teď. Nedávno se v Evropě řešila kauza s nástrojem umělé inteligence od Elona Muska pojmenovaným Grok. Pomocí něj totiž uživatelé začali tvořit pornografické obrázky jiných skutečných lidí, a to bez jejich souhlasu. Některé z obětí byly nezletilé.

Největší tajemství Survivoru odhaleno: Krézlová přiznala, jak získávala zakázané jídlo

Související články

eXtra vyvrací fake news: Zabíjejí větrné elektrárny ptáky? Zjistili jsme, jak to je

eXtra vyvrací fake news: Temné zákulisí maďarských voleb. Kdo se je ve skrytu snaží ovlivnit

eXtra vyvrací fake news: Pozor, na sítích se šíří falešná videa z útoku na Írán

eXtra vyvrací fake news: Budou Ukrajinci bojovat kvůli Grónsku proti USA? Další lež